Durante la campaña electoral, Barack Obama sorprendió, en reiteradas ocasiones, con alusiones directas al incremento de profesores de matemáticas (estadísticos, analistas de datos…) en el sistema de educación norteamericano como garantía para la competitividad y la innovación en la economía.

Sin embargo, su defensa de estas profesiones venía de lejos. No era una intuición, era una convicción. En febrero de 2011, un año antes de que comenzaran las campañas (con las primarias de fondo), el presidente Obama presentó su propuesta de presupuesto en el que la cifra asignada al área de educación era de las pocas donde se veía un aumento. El Presidente exigía que un total de 77,4 mil millones de dólares fueran invertidos en reformas dirigidas a los temas de ciencia, tecnología, ingeniería y matemáticas. Para algunos, este apoyo a la educación era tan solo una demostración de su adhesión a políticas sociales asistencialistas, pero estaban equivocados. Obama entendía, como pocos, la necesidad de reactivar la economía del país a través de un fuerte y decidido impulso tecnológico y una cultura científica basada en las matemáticas como estímulo para la creatividad.

La fe y la lealtad de Obama en los matemáticos, ingenieros e informáticos fueron cruciales en su defensa y argumentación sobre cómo conseguirlo. Para algunos era inaudito que el presidente de los Estados Unidos hablara de la necesidad de tener y formar a más profesores, más matemáticos y más ingenieros en un momento en el que la tasa de desempleo no bajaba del 8%.

“Había más imaginación en la cabeza de Arquímedes que en la de Homero”.

Voltaire

La Cueva

Un día después de su victoria electoral, Obama nos mostró su “secreto”. Solo un medio de comunicación, TIME Magazine (que ha vuelto a conceder al Presidente el título de “personaje del año”, como ya hiciera en 2008), conocía hasta ese momento la que había sido su arma secreta en la consecución de los votos electorales clave. El miércoles 7 de noviembre, la revista estadounidense publicó el artículo que revelaba las interioridades de La Cueva.

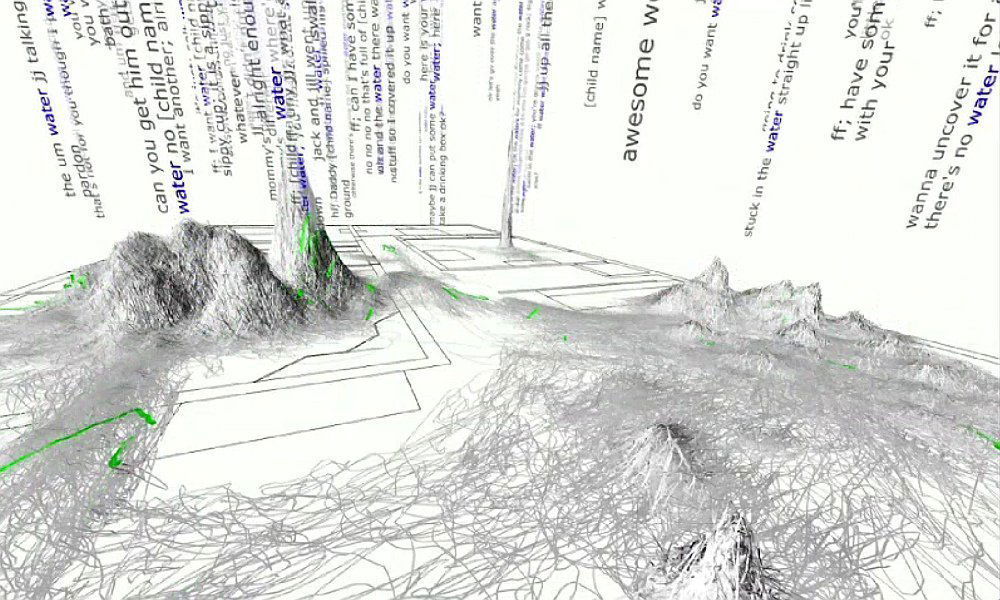

La Cueva era una sala secreta del cuartel general de campaña en Chicago donde se ponía en marcha toda la maquinaria cibernética que consiguió el método de análisis, prospectiva, simulación y estrategia que garantizó su victoria. Como en la película El club de la lucha, existían unas reglas y las tres primeras tenían que ver con mantener en silencio su existencia.

Durante muchos meses, un equipo de informáticos y matemáticos permanecieron encerrados en un recinto aislado al que solo su jefe de campaña, Jim Messina, tenía acceso y conocimiento sobre las actividades que allí se realizaban.

La campaña de Obama logró construir “la mayor maquinaria política en los EEUU, con delegaciones establecidas durante más de un año en los Estados decisivos y apuntalada por herramientas digitales pioneras” que jamás se habían visto. Ya no se trataba de conseguir información, ni voluntarios, sino de aprovechar la información de la mejor manera posible. Ningún dato sobraba y todo era relevante, desde las costumbres del día a día de los votantes hasta dónde iban de vacaciones los indecisos. Todo ello iba alimentando una gigante bóveda de datos.

El método

Un gran big data electoral (respondiendo al principio de las “3V”: alta velocidad, alta variabilidad, alto volumen) fue gestionado para identificar patrones de comportamiento e hipótesis de respuesta a los estímulos, la acción y la comunicación política. Datos “físicos” (datos públicos vinculados a la identidad, el geoposicionamiento, las condiciones socioeconómicas o territoriales y el comportamiento electoral), a los que se añadieron datos de “consumo” (adquisiciones, subscripciones, donaciones, aportaciones…), más datos de “conversaciones” (gracias a la minería de datos de las redes sociales) y, finalmente, datos “experimentales” de la acción política en la comunicación digital o en la campaña de tierra (puerta a puerta, call centers…).

Todo ello permitió la gestión de información segmentada en decenas de criterios sobre los votantes, sus gustos y su modo de vida, demostrando que el ganador sería quien más compartiera con ellos, afinidades y preocupaciones. Esto, finalmente, fue lo que ayudó al equipo de Obama a diseñar un mensaje específico, centrado y dirigido a cierto segmento de la población, con un mejor y mayor control.

El proceso fue largo y arduo. Durante 18 meses, el equipo de La Cueva se dedicó a unificar todas las bases de datos que habían empleado los diversos equipos de campaña de Obama en 2008. El resultado fue una gran base de datos que incluía desde listas de donantes a datos recogidos por encuestadores y voluntarios -que habían ido puerta a puerta durante meses buscando el voto-, o recopilados a través de las redes sociales. Esos datos fueron cruzados, comparados y verificados continuamente hasta el último minuto de campaña y hasta el último detalle relacionado con el votante.

“Las matemáticas poseen no solo la verdad, sino cierta belleza suprema. Una belleza fría y austera, como la de una escultura”.

Bertrand Russell

Una vez contaban con esa artillería, los técnicos comenzaban a testear perfiles de decenas de millones de electores con programas informáticos de predicción sobre distintas reacciones y motivaciones que podrían llevar a una persona a votar por Obama. En ese punto, el género, la edad, el nombre y la raza se convertían solo en un primer umbral de la información; los analistas debían conocer, también, el tipo de series de televisión que veían en su tiempo libre, o los medios a través de los cuales compartían información con sus amigos; es decir, actitudes, gustos y disgustos de su vida en general.

Y aquí entró en juego Facebook. A través de esta red social, mediante la aplicación Are you in, el votante podía inscribirse, ya fuera para ayudar, para ser voluntario o simplemente para informarse; daba igual, lo importante era que, al conectarse con Facebook, el usuario daba acceso directo al equipo de Obama no solo a su perfil sino al perfil de todos sus amigos en esa red social. Esto terminó por convertir la gran cantidad de datos en un alud gigante de información sobre millones y millones de personas.

Controlar y saber manejar esta información era el mayor reto. Pero una vez más su ejército de nerds encerrados en el cuartel de La Cueva lograron sacar el mejor provecho a cada dato, a cada nombre y a cada Estado, de tal manera que cada nombre y cada dato se convirtieron -potencialmente- en un voto.

El rival

El equipo de Obama no descubrió nada, solo se adaptó mejor. Mitt Romney y su equipo usaban una, hasta entonces, buena base de datos denominada ORCA, que alimentaban con los datos que iban consiguiendo en campaña y que tenía como principal objetivo conseguir que el día de las elecciones sus simpatizantes fueran a votar. Sin embargo, no funcionó del todo y muchos datos se perdieron. No era tan buena, ni tan actualizada, ni conseguía encontrar las relaciones entre los activistas que sí consiguió la herramienta de Obama.

El equipo del Presidente sí innovó: de las redes sociales a la estrategia de datos. Como indicaba David Axelrod respecto al cambio de herramientas online: “En 2008, este tipo de campaña usaba la mejor tecnología posible. Pero estamos a años luz de donde estábamos en 2008. Hemos tenido que reinventarnos y pensar en todas las herramientas que estaban disponibles para nosotros -que proporcionan datos más ricos, más medios quirúrgicos para hablar con los votantes. Se trata de invertir en personas -son casi mayoritariamente jóvenes- que entienden dónde va la tecnología y cuál será su potencial en el año 2016 en comunicaciones, para apuntar al blanco, para la minería de datos, para conseguir la mayor precisión posible en términos de persuasión y movilización. […] Sabemos mucho más sobre el electorado que en 2008. Podíamos hacer juicios más precisos sobre las actitudes de los votantes, sobre lo que era importante para ellos individualmente, sobre quién iba participar y quién no era probable que participara. Así que teníamos gran confianza en nuestros datos. Recibí informes cada noche”.

El horizonte

No se puede hablar de Big Data sin hacer referencia a Nate Silver, el estadístico que revolucionó las predicciones electorales de los medios de comunicación y las empresas de sondeos y encuestas con un método basado en la estadística y la probabilidad y no en la medición e interpretación. La innovación real en las pasadas elecciones fue la relevancia de los modelos estadísticos por encima de las apreciaciones de los pundits (tertulianos de toda la vida) sobre el desarrollo de las elecciones.

Su método era simple, pero complejo al mismo tiempo: 1. Hacía la suma de muchas (muchas!) encuestas. 2. Sacaba un promedio, no un promedio simple ya que tenía en cuenta tres variables: a. Momento de la publicación de la encuesta, b. Margen de error, c. Calidad (el medio que la publicaba, si históricamente había acertado o no…). 3. Estudiaba cada Estado. No se centraba en las encuestas de intención de voto a nivel nacional sino de Estado por Estado. Para ello también se tenía en cuenta la elección de senadores, la participación histórica, la ventaja del candidato, los factores demográficos… todo a través de una regresión lineal. 4. Finalmente, esos datos se introducían a modo de algoritmo en un software que ofrecía los resultados finales.

Las disciplinas y profesiones estratégicas para la gestión eficiente de la política y de las campañas electorales van a padecer un vuelco: de las ciencias sociales (sociólogos, periodistas, politólogos, asesores de comunicación…) a las ciencias exactas (matemáticos, estadísticos, analistas de datos, visualizadores gráficos).

España

Nuestro país (y nuestra política) tiene un gran déficit en cultura matemática. Hay buenos profesionales, pero no hay un reconocimiento a la profesión y nuestra arquitectura de datos públicos disponibles es muy baja en relación a la media europea. No es extraño que seamos uno de los poquísimos países que no tiene -todavía- legislación sobre la transparencia y que el Open Data y el Open Government estén muy retrasados en su desarrollo. Además, en España, el reto es doble: la producción de datos brutos y el know how para su análisis. No se trata solo de producir los datos sino de saber analizarlos (cruzarlos, ponderarlos) y convertirlos en información útil para su reconversión en votos. Cada detalle cuenta. Convertir los datos en comportamientos es la clave, para comprender el fondo de los votantes: “Sin matemáticas no se penetra hasta el fondo de la filosofía; sin filosofía no se llega al fondo de las matemáticas; sin las dos no se ve el fondo de nada”.

(Bordas-Desmoulin)