Los algoritmos llegaron a la tecnología social para mejorar nuestras vidas. Son operaciones matemáticas complejas que se utilizan para dar respuestas a necesidades. Esto, dicho así, queda muy amplio, pero se puede traducir de forma sencilla: el usuario lleva a cabo una acción y –algoritmo mediante– el sistema le devuelve una respuesta supuestamente satisfactoria.

A nivel terrenal los algoritmos se utilizan, por ejemplo, cuando hacemos búsquedas. Google indexa –esto es, lee y categoriza– el contenido de un montón de páginas web. Cuando buscamos algo utiliza diversas operaciones –algoritmos– para establecer relaciones: si utilizas los términos restaurante, brasileño y Vigo, buscará páginas cuyo contenido sea –o esté relacionado– con ser un restaurante brasileño en Vigo. O algo parecido.

Cuanto más afinado esté el algoritmo en cuestión, más acertadas serán las respuestas. Luego ya está el aprendizaje paralelo del sistema: cuanta más gente haga esa búsqueda y pinche en los resultados mostrados, más repetirá esa selección porque entenderá que el hallazgo fue satisfactorio. A esa ecuación convendría sumar otros condicionantes: dónde estás, qué tipo de búsquedas haces y cómo de bien o mal trabaja el SEO el restaurante en cuestión.

Hasta ahí la cara sencilla –nótense las comillas virtuales– de los algoritmos. A grandes rasgos, la cosa se complica cuando se exporta esa lógica de hacer la vida de los usuarios mejor a otras latitudes. Por ejemplo, cada vez que Facebook te sugiere a qué personas podrías conocer. O cuando, de pronto, todos los anuncios que ves en cada página tienen que ver con el producto que acabas de buscar –o peor, con la conversación que acabas de tener–. O cuando directamente ves o dejas de ver cosas porque un algoritmo decide que lo que te va a enseñar es lo que de verdad te interesa.

Lo primero –lo de recomendar amigos– viene de cruzar información: si eres amigo de ciertas personas y dichas personas comparten ciertas amistades, el sistema entiende que puede que también sean amigos tuyos y, por tanto, te haga ilusión encontrarlos.

Lo segundo –lo de la publicidad programática– tiene que ver con que si has estado buscando ciertos productos, el sistema entiende que te interesan, así que es mejor mostrarte publicidad vinculada con cosas que te gustan que mostrarte cosas que quizá no te vayan para nada. Así ganan todos: ganas tú, que solo ves cosas que te interesan, y ganan los anunciantes, que aseguran el tiro.

LO QUE NO QUEREMOS VS. LO QUE QUEREMOS

Ahora bien, ¿y si el sistema te enseña a alguien que conoces pero no quieres agregar como amigo porque –azares de la vida– acabasteis fatal? Sí, el sistema acierta en que le conoces, pero es que las relaciones personales son algo más que vincular respuestas con preguntas. Hay respuestas correctas en una máquina pero tremendamente inadecuadas en humanos.

Y ahí entra lo tercero: cuando un algoritmo decide qué cosas enseñarnos y qué cosas obviar. Por ejemplo, ver actualizaciones de algunos contactos pero esconder las de otros porque el sistema entiende que te interesan más unos que otros. Y puede que sea verdad ya que, a fin de cuentas, promocionará el contenido de aquellos contactos con los que hables, a los que visites, comentes o interactúes. Ahora bien, ¿quiere eso decir que el resto no son importantes?

Esa pregunta, en un segundo nivel, se transforma en la profecía autocumplida: si el algoritmo solo te enseña cosas porque supone que son las que te interesan, al final acabas consumiendo esas cosas sencillamente porque no tienes acceso a otras.

Cuando hablamos de amigos, o de contactos a los que seguimos, la cosa puede parecer más o menos inocente. El problema viene cuando eso se produce con otro tipo de contenidos, dando lugar a burbujas dentro de las cuales solo se ven cosas que –en teoría– nos gustan y solo se escuchan opiniones con las que –en teoría– coincidimos. Aquí la profecía autocumplida toma la forma de cámara de eco primero y burbuja epistemológica después: solo nos exponemos a aquello con lo que coincidimos y, en caso de que algo ajeno se salte la barrera, estaremos preparados para detectarlo y desacreditarlo.

Esta línea de debate expone posturas contrarias. Hay quien dice que estamos programados para evitar las discrepancias, prefiriendo dejar de prestar atención a aquello que no nos gusta. Así, de la misma forma que no compramos periódicos cuya línea editorial nos desagrada, nos supone un enorme esfuerzo no bloquear o dejar de seguir a gente que dice cosas con las que no estamos de acuerdo.

Hay, por contra, quien dice que lo digital en realidad no empeora esto sino al revés, que ayuda a combatirlo. Lo haría básicamente exponiéndonos a más información de la que nunca hemos tenido acceso y haciendo difícil controlar lo que los demás dicen.

CUANDO LA MÁQUINA DECIDE POR EL HUMANO

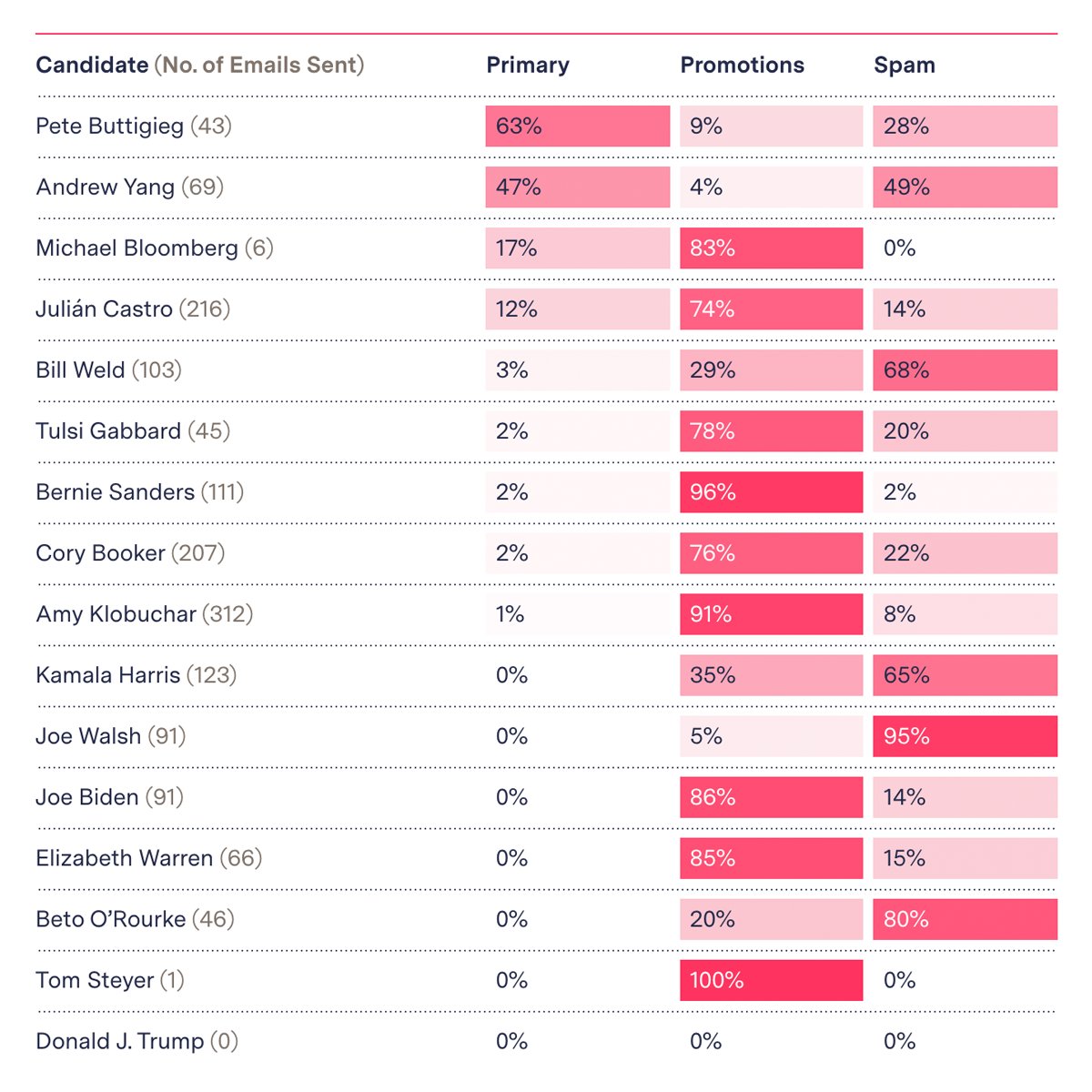

Ahora bien, ¿somos conscientes siempre de la forma en que esos filtros algorítmicos actúan? En The Markup hicieron un interesante experimento suscribiéndose a los boletines informativos de 16 precandidatos demócratas durante las primarias y comprobaron que los filtros de GMail actuaban de forma desigual, decidiendo por el receptor –que voluntariamente se había suscrito– cuáles de esos correos enviaba a la bandeja de entrada y qué otros escondía.

Esa es la parte perversa del algoritmo. La tecnología, sin la capa de humanización necesaria, codifica la realidad a través de lo correcto e incorrecto sin pensar en los efectos de lo adecuado o inadecuado. De lo voluntario o involuntario y de las motivaciones detrás de cada decisión.

Precisamente esa lógica es la que ha llevado a algunas compañías a replantearse la forma en que sus sistemas codifican la realidad. Una de las vías de solución al problema ha sido hibridar el sistema, de forma que los algoritmos hacen parte, pero los resultados se basan también en las acciones de la gente. Así, si haces un buen trabajo de SEO, tu contenido escalará posiciones; o si haces un buen trabajo de ASO, sucederá lo propio con tu app en la tienda de aplicaciones.

Facebook, por ejemplo, entendió que aunque una actualización tenga muchos comentarios e interacción no tiene porqué querer decir que sea una memoria que se quiera rescatar. Sucedió, por ejemplo, cuando usuarios comunicaban problemas, penas o pérdidas personales, incluso fallecimientos de otros usuarios.

Porque el problema tiene ecos emocionales, pero también de lógica de negocio. Así, y a pesar de ese intento de hibridación, las tiendas de aplicaciones solo hacen visibles un puñado de apps, mientras que invisibilizan otras muchas a las que a duras penas llegarán el usuario –a pesar de que encajen exactamente con sus necesidades–. Y sigue insistiendo en rescatar recuerdos negativos pensando que son positivos, al tiempo que sigue evitando dar la posibilidad a los usuarios de expresar sentimientos negativos.

Otro caso interesante es el de Spotify, donde las recomendaciones relacionadas con el tipo de música que escuchamos se han convertido en un potente motor de crecimiento de la herramienta, y tienen todo el sentido. A saber, la gente siempre escucha su música favorita y eso acaba cansando, de forma que una manera acertada de incrementar su consumo podía ser recomendar música que –a través de algoritmos– tuviera muchas posibilidades de encajar con sus preferencias. Si a eso se le añade algo de sensibilidad al hacerlo, incluso sentido del humor, mejor que mejor.

Cançons recomanades per Spotify.. té el seu punt de gràcia pic.twitter.com/cM3DqyQjxY

— danieljulia.tez (@daniel_julia) March 18, 2020

Ahora bien, en una misma línea de lo explicado con anterioridad, aunque en sentido contrario, podría pensarse en la opción de esconder voluntariamente aquello que no se quiere: canciones que aunque gustaban antes han dejado de gustar (por cansancio o porque recuerdan a una situación a la que no se quiere volver, por ejemplo). O sencillamente porque, aunque a todo el mundo le guste algo, quizá a ti te ponga de los nervios.

Estimados amigos usuarios de @SpotifySpain: ¿Hay alguna forma de vetar determinadas canciones para que no se reproduzcan jamás como, no sé, cualquier de Melendi?

Gracias.

— Sara de la Peña (@sarappm) March 3, 2020

LA DIMENSIÓN ECONÓMICA DE LA INFORMACIÓN

Como buen negocio que es la comunicación en general –y el periodismo en particular– no ha sido ajena a las tentaciones de esta automatización de la selección. Cómo resistirse a caer en las redes de sistemas algorítmicos capaces de predecir con acierto qué interesará a mi audiencia, con lo que eso supone en ahorro de esfuerzos y maximización de beneficios.

Así, los medios llevan años empleando ese tipo de técnicas para diseccionar audiencias e intereses y captar la atención de sus lectores. Y lo han llevado al extremo de pasar a crear contenido más pensando en las máquinas, sus intermediarios, que en la audiencia final. Por eso cuando Google o Facebook deciden cambiar sus algoritmos operativos, la industria se echa a temblar –o directamente se derrumba, como pasó con los medios para millenials–. A fin de cuentas, esos intermediarios también son negocios y necesitan a los medios mucho menos de lo que los medios los necesitan a ellos.

En toda esta componenda muchos teorizan que los usuarios dejan de ser el centro del proceso para pasar a ser solo una parte del mismo. Y lo que eran los pilares que regían la idea de la comunicación y el acceso a la información –a saber, la libertad como esencia de la democracia– parecen estar en entredicho. Si todo es un negocio y todo se hace para captar la atención, es que nada en realidad es necesariamente relevante.

Es fácil escudarse en el hecho de que cuanto mejor sea la tecnología más difícil será distinguir entre verdad y mentira, y también en el hecho de que la audiencia es solo un sujeto pasivo de ese proceso ajeno a su poder. La realidad, sin embargo, es distinta: si todo lo que hacen los creadores de contenido y sus intermediarios es para que consumamos más contenido, será que no somos tan pasivos y tan inactivos. Importamos, vaya.

Y eso nos devuelve ante una incómoda realidad: la culpa no es de las redes sociales, de los motores de búsqueda o de los algoritmos, sino nuestra. Elegimos exponernos a esos filtros porque preferimos que nos digan qué nos interesa, quiénes son nuestros amigos, qué productos querríamos comprar o qué canciones podríamos estar interesados en descubrir. Si queremos evitar que otros decidan por nosotros, siempre podemos volver a buscar por nuestra cuenta. Aunque eso suponga vivir una vida menos cómoda.